- 产品价值

- 产品功能

- 产品优势

- 应用场景

- 客户案例

-

一体化大模型训推

一体化大模型训推

- 提供大模型微调、优化、部署推理和评测的一体化服务

- 较人工处理,节约时间成本50%+

-

大模型推理加速

大模型推理加速

- 采用多种量化加速策略

- 帮助客户已有应用模型进行FP8量化时延降低约34.8%

-

GPU共享调度

GPU共享调度

- 同一张加速卡上按需运行多个模型服务

- 提高GPU利用率,减少资源浪费

-

异源模型统一纳管

异源模型统一纳管

- 实现自有、公有云和开源模型的统一管理

- 采用OpenAPI标准化

-

分布式训练

分布式训练

- 支持65B参数以上规模的模型

- 65B模型64卡分布式训练降低训练时间75%,由原来5个小时降低至现在75分钟

-

信创适配与可观测性

信创适配与可观测性

- 支持大模型在国产硬件如华为昇腾NPU、海光DCU等加速卡上进行训练与推理

- 实现多维度监控与分钟级异常修复

-

动态GPU资源潮汐调度

动态GPU资源潮汐调度-

根据系统负载变化,动态分配和回收资源,最大化GPU资源利用,降低成本

-

针对不同工作负载场景,如实时对话,电销,质检和会话洞察等场景,提供潮汐调度或优先级调度等策略,最大化利用GPU资源,降低平台使用成本

-

-

低门槛SFT工具

低门槛SFT工具

开箱即用的大模型微调工具

全量/LoRA微调,支持增量训练

-

模型压缩工具配套

模型压缩工具配套

内置多种模型量化加速工具

一键进行模型量化

-

模型推理加速

模型推理加速

自研高性能推理引擎

推理性能相比开源加速引擎提升30%+

-

可视化监控

可视化监控

评估报告可视化、日志可视化、事件可视化、算力可视化、服务调用可视化

高可观测能力

-

高效资源利用

高效资源利用

multi_LoRA部署模型,多个模型服务共享一个接入点,卡资源成倍降低

自定义GPU Share策略,灵活资源分配,避免资源浪费

-

国产化信创适配

国产化信创适配

异构资源调度

支持基于NPU、DCU进行模型训推

丰富的实践SOP,更懂行业,更懂业务

-

金融

异构算力调度

异构算力管理

算力使用优化

模型训练

模型部署

模型推理

模型加速

智能风控

智能问答

智能质检

智能客服

-

公安

智能接警

反诈知识

智能导侦

警情分析

笔录协同

立案推荐

智能研判

远程调证

智能文书

智能监督

-

政务

集群调度

资源监控

模型优化

智能便民助手

政务助手

数字人

公文写作

公文纠错

智能审核

智慧城市

-

制造

行业知识库

缺陷分析

设备检修

故障定位

故障分析

工艺质检

良率分析

智能排产

生产调度

报告写作

-

交通运输

知识问答

方案生成

评标辅助

交通规划

智慧交管

数据问答

病害识别

收费智能

监理问答

路网规划

资源调度

-

电力

运维助手

智能调度

设备运维

智能办公

公文拟稿

智能校对

电费稽查

能效诊断

模型训练平台

企业级大模型开发平台

一站式服务简化大模型训、推、评全流程

- 大模型训练推理加速部署一体化

- 解决模型训练难、成本高、人才短缺等难题

- 助力企业快速构建大模型平台

产品价值

- 减少资源浪费,GPU共享调度

- 多维度监控与分钟级异常修复

- OpenAPI标准化,异源模型统一纳管

- 华为昇腾NPU、海光DCU等信创适配

- 一体化大模型训推,节约时间成本50%+

- 大模型推理加速,FP8量化时延降低34.8%

- 65B模型64卡分布式训练降低训练时间75%

产品功能

一站式大小模型训推

- 在资源受限或需要快速响应的环境中,提供一站式服务,显著降低模型训练与推理成本

模型量化压缩

- 通过模型量化技术,优化GPU资源使用,服务更多AI应用场景,实现资源的高效利用

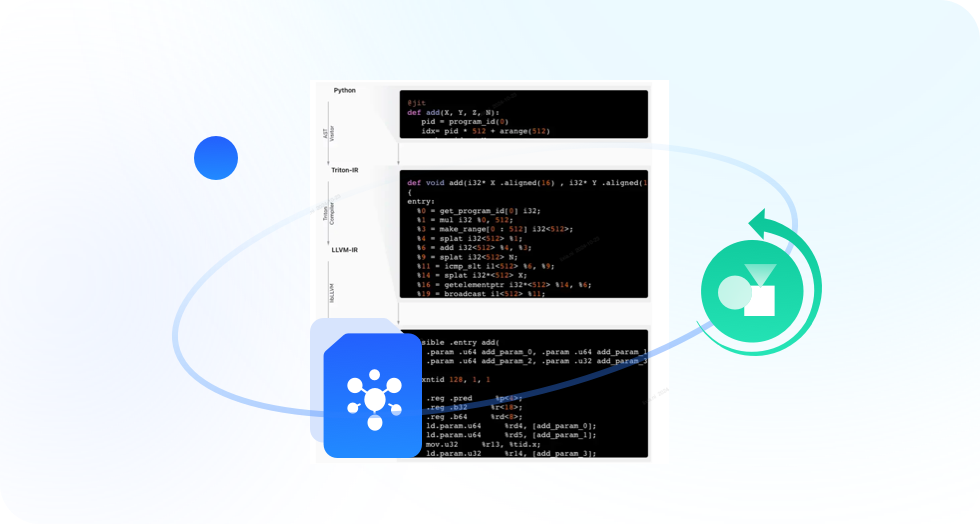

Triton引擎推理加速

- 将模型参数转换并编译为GPU指令相关的二级制文件,提高运行时计算效率

GPU虚拟化

- 实现物理GPU资源(如显存、流处理器、纹理单元等)可以被多个虚拟机或容器共享

- 提升GPU利用率,并降低平台使用成本

动态GPU资源潮汐调度

- 根据系统负载变化,动态分配和回收资源,最大化GPU资源利用,降低成本

- 针对不同工作负载场景,如实时对话,电销,质检和会话洞察等场景,提供潮汐调度或优先级调度等策略,最大化利用GPU资源,降低平台使用成本

模块化按需服务快速部署

- 支持不同客户诉求的模块选择组合,具备异构、多种大模型组合的能力,可实现快速部署实施,满足个性化服务需求

产品优势

低门槛SFT工具

- 开箱即用的大模型微调工具

- 全量/LoRA微调,支持增量训练

模型压缩工具配套

- 内置多种模型量化加速工具

- 一键进行模型量化

模型推理加速

- 自研高性能推理引擎

- 推理性能相比开源加速引擎提升30%+

可视化监控

- 评估报告可视化、日志可视化、事件可视化、算力可视化、服务调用可视化

- 高可观测能力

高效资源利用

- multi_LoRA部署模型,多个模型服务共享一个接入点,卡资源成倍降低

- 自定义GPU Share策略,灵活资源分配,避免资源浪费

国产化信创适配

- 异构资源调度

- 支持基于NPU、DCU进行模型训推

您的账号体验有效期已结束

您的账号体验有效期已结束

线索洞察

查看详情

多语言语音客服系统

查看详情

CRM呼叫中心

查看详情

自动拨打电话机器人

查看详情

智能洞察

查看详情

外贸独立站客服接待系统

查看详情